音声認識の普及により、私たちの日常生活やビジネスに大きな変化が訪れています。AI技術の進歩に伴い、音声認識の精度や活用方法もさまざまになってきました。

この記事では、AI技術を活用した音声認識について、仕組みや実際の活用例、ビジネスに導入するメリット、今後の課題までを探ります。これからも活用シーンが広がっていくであろう音声認識について知り、さまざまな分野での効果的な活用を考えていきましょう。

目次

音声認識とは?

音声認識とは、音声データを解析してそれをテキストデータに変換する技術です。AI技術を応用した音声認識システムでは、音声入力を自動的にテキストに変換することができます。この技術は、マイクやスマートフォンなどのデバイスを通じて行われ、さまざまな目的に活用されています。

音声認識は、人々が自然な音声でコミュニケーションを取ることを可能にし、生活やビジネスの効率化を支援しています。また、機械学習やディープラーニングといったAI技術の進歩により、音声認識の精度と応用範囲は飛躍的に向上していきました。

音声認識技術に関する本格的な研究は、1971年のアメリカの「音声理解システム(SUS)」から始まったと言われています。以降も研究が続けられ、2000年代になるとアルゴリズムの改善により精度が大幅に向上し、実用化レベルの音声認識が可能となりました。

それからは実際にカーナビやパソコンソフト、スマートフォンなどに搭載され、今や音声認識は私たちの生活に根付いた技術であると言っても過言ではないでしょう。今後も技術の発展は進み、さらに生活の中に浸透していくと考えられます。

音声認識技術の仕組み

音声認識技術はどのような仕組みになっているのでしょうか。ここでは、多くの音声認識システムで採用されている従来型の「DNN-HMM型」と呼ばれる仕組みについて解説します。「DNN-HMM型」では、大きく分けて音響分析・音響モデル・単語に変換・テキスト出力という4つの段階を踏みます。

音響分析でデジタルデータ化

まずは入力された元の音声データを音響分析し、デジタルデータ化します。音響分析とは、音声を定量的に示す「特徴量」と呼ばれる数値に変換し、AIが認識しやすい音声にする作業のことを指します。

入力された音声から、音の周波数や強弱、間隔、時系列などの特徴を抽出してデジタル信号に変換し、コンピューターが認識しやすいようにデータの整形を行います。

音響モデルで音素を抽出

音響分析でデジタルデータ化された音声は、その特徴量がどのような「音素」に近いのかをコンピュータの学習パターンと照らし合わせていきます。音素とは、日本語における母音や子音、発音、撥音などのことで、音波の最小単位でもあります。このように音素を抽出する作業を音響モデルと言います。

発音辞書と言語モデルで単語に変換

音響モデルで抽出した音素は、「発音辞書」と「言語モデル」で意味が通じる単語に変換します。発音辞書は発音と単語が登録されたデータベースであり、音響モデルと言語モデルを結びつけるための役割を持っています。

言語モデルは、単語や文字列が文章として適切なものかを評価するために使われる仕組みです。日本語の音声認識の場合は、日本語のテキストを大量に統計処理した言語モデルを使用して、発音辞書で特定した単語を意味のある言葉に変換していきます。

適切な文章の組み立て

言語モデルによって音声が意味のある言葉に変換されたら、日本語として意味の通じる自然な文章として組み立てられ、テキスト出力されます。このような処理を経て、音声データがテキスト化されていくのです。

音声認識の精度向上にAIが活躍

音声認識技術は、2000年代以降大幅に精度が向上しました。その背景には、AIの搭載とその技術の進歩があります。

AI(人工知能)とは?

AIとは「Artificial Intelligence」の略で、日本語に訳すと「人工知能」です。人工知能とは、人工的に作られた知能、つまりコンピュータによる知的な処理や判断のことを指します。人間が思考するのと同じような機能を実現するために開発されているのが、AI技術です。

AIは、機械学習によってコンピュータ自らが学習し、知的な判断や推論を行います。中でも深層学習(ディープラーニング)は、音声認識の精度向上にも大きな影響を与えました。

AI搭載型の音声認識の仕組み

前述した従来型の音声認識技術の仕組みは、日本語のテキストを統計処理したモデルを用いたものです。しかし、AI搭載型のディープラーニング技術を用いた音声認識では、音響モデルから言語モデルまでのプロセスが、人間の脳を模した1つのニューラルネットワークモデルで実装されています。

このモデルでは、解析した単語の次に出現する可能性が高い単語を自動で予測できるようになり、膨大な情報の処理が可能になりました。そのため、音声認識の精度向上にもつながったのです。

音声認識の活用例

現在、音声認識技術はさまざまなシーンで活用されています。その活用例を見てみましょう。

ボイスアシスタント

ボイスアシスタントは人間の音声を認識し、対話やタスクの実行をサポートするAIシステムです。日常生活のさまざまな場面で活用されており、生活を便利にする存在となっています。具体的な例としては、SiriやGoogleアシスタント、Amazon Alexaなどが挙げられます。

スマートスピーカー

スマートスピーカーは、前述のボイスアシスタントを搭載したスピーカーです。スピーカーに話しかけると、スマートホームデバイスの制御や音楽再生、天気予報の確認など、要求に応じたサービスを提供します。具体的な例としては、Amazon EchoやGoogle Homeなどがあります。

コールセンターの自動応答

コールセンターの自動応答に音声認識技術を活用すると、顧客の音声をリアルタイムで認識して問い合わせ内容を解析できるため、自動的に適切な対応を行うことが可能になります。例えば、一般的な問い合わせや頻繁に寄せられる質問に対して、事前に設定された応答を自動的に返答するという使い方が考えられるでしょう。

音声認識を活用したコールセンターの自動応答は、対応の効率化や顧客満足度の向上が期待できます。人力で対応するよりも多くの問い合わせに対応することができるため、コスト削減にもつながるでしょう。

音声入力

文章を作成する際に、キーボード入力ではなく音声入力を活用することも可能です。人が話した言葉をテキストに変換して出力するため、手軽に文章を作ることができます。

音声入力による文章作成は、特に手が使えない状況や、高速での入力が求められる場面で有用だと考えられます。ただし、正確性やノイズの影響など、認識の精度や環境条件には注意が必要です。

自動翻訳

音声認識技術を応用して、多言語間の自動翻訳を行うこともできます。人が話した言葉をテキストに変換し、それを翻訳することで、リアルタイムでの自動翻訳が可能になります。

音声認識技術を活用した自動翻訳は、会議やイベント、国際旅行などのシーンにおいて、異なる言語間でのコミュニケーションを円滑にするのに大きく役立っています。ただし、専門的な文脈やニュアンスの理解には課題が残っていますので、まだまだ人間の翻訳者のサポートが必要なケースもあります。

議事録作成・文字起こし

音声認識技術を使用して、会議や取材などの録音データをテキストに変換することで、議事録作成や文字起こしを自動化することができます。

従来の手動での議事録作成や文字起こしでは時間と手間がかかる上に、ヒューマンエラーも発生する可能性がありました。しかし、音声認識技術を活用することで、リアルタイムでの録音データのテキスト変換が可能となります。これにより、迅速かつ正確な議事録や文字起こしを作成することができます。

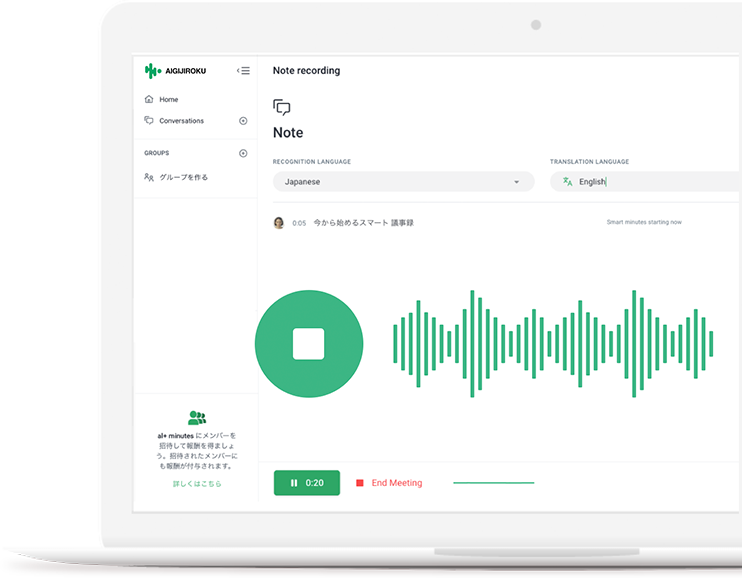

AIを活用した議事録作成ツールの1つに、AIGIJIROKUがあります。AIGIJIROKUは、AIが99.8%の高精度で会話の内容をテキスト化します。どんな企業でも日常的に発生する議事録作成業務の負担を削減することができますので、ぜひ利用を検討してみてください。

音声認識をビジネスに導入するメリット

近年は、業務の効率化などに音声認識技術を活用する企業も増えてきました。ここからは、音声認識をビジネスに導入するメリットがどのような部分にあるのかを解説します。

業務効率化につながる

音声認識によるデータ入力を導入すると、キーボードやマウスによる手入力よりも迅速に作業を進めることができます。議事録作成や打ち合わせ内容の書き起こしなども、その場でリアルタイムに記録できるため、業務効率化につながるでしょう。

業務精度の向上につながる

昨今の音声認識は、高い精度で音声をテキストに変換できるようになっています。そのため、人間の手入力に比べて入力ミスやタイプミスのリスクが減少し、正確なデータ入力や文章作成が可能となり、業務精度の向上につながると考えられます。

ボタン操作よりも操作性が高くなる

音声入力は、ボタン操作よりも直感的な操作が可能になります。ボタン操作では操作手順やボタンの配置に慣れる必要がありますが、音声認識は会話のような形で操作できますので、初めての利用者でも使いやすいと言えるでしょう。

さらに、音声認識はハンズフリーで操作できるため、両手が自由に使える状況や移動中などでも利用しやすくなります。総合的に考えると、音声認識はボタン操作よりも操作性が高く、使いやすいインタフェースとして注目されています。

問い合わせや案内対応をある程度自動化できる

電話での問い合わせ対応や窓口案内に音声認識を活用すると、AIで初期対応を行うことができ、業務の一部を自動化することが可能になります。質問内容を聞き取って自動回答を返し、複雑な内容である場合のみオペレーターが対応する、といった流れを構築すればオペレーターの業務負担につながるでしょう。

顧客満足度の向上につながる

音声認識を活用することによって、顧客の要望への対応がスピーディーになります。スタッフ側の業務負担が軽減されるだけでなく、顧客の待ち時間が短縮でき、よりスムーズにサービスを提供できるようになるでしょう。

また、音声認識だと顧客は自然な会話の流れでサービスを利用できるため、手続きや入力作業のわずらわしさが軽減されます。音声認識を導入すると、迅速でストレスの少ないサービス提供ができ、顧客満足度の向上にもつながると考えられます。

音声認識技術における課題

ここまででご紹介してきたように、音声認識は日常生活・ビジネスともにさまざまなシーンで活用されています。そのメリットも大きく、今後さらに活用シーンは広がっていくと考えられるでしょう。

しかし、音声認識技術はまだまだ発展途上であり、改善すべき課題もあるのが現状です。最後に、音声認識技術の課題について解説します。

雑音やノイズがあると精度が下がる

音声認識技術における課題の 1つは、環境中に存在する雑音やノイズが精度に影響を及ぼすことです。周囲の話し声や風の音、BGMなどのノイズがある環境では、音声のクリアな取得が難しくなり、認識精度が低下することがあります。この課題に対処するためには、ノイズキャンセリングや音声前処理技術の活用などが求められます。

複数人の同時発話を識別しづらい

現在の音声認識技術では、1人の発話を聞き取ることはできますが、複数人の同時発話は識別しづらいという課題があります。複数の話者が同時に発話すると、音声の重なりや干渉が生じてそれぞれの発話を正確に区別することが難しくなり、認識精度が下がりやすくなってしまうのです。

この課題に対応するためには、話者の識別ができるより高度なアルゴリズムや技術の開発が求められます。既に改良されているツールもありますので、複数人が同時発話する環境で音声認識を使いたい場合は、そういったツールを選ぶとよいでしょう。

方言やスラング、若者言葉など独特の言葉遣いは認識しづらい

音声認識の発音辞書や言語モデルは、一般的に標準語で作成されていることが多いものです。そのため、方言やスラング、若者言葉など独特の言葉遣いが含まれていると、正確に認識しづらくなってしまいます。

こういった言葉遣いに対応するには、特定の地域やコミュニティに特化したデータを収集して、言語モデルの拡充を行う必要があります。近年は、機械学習やディープラーニングの進展によって、より広範な言語バリエーションをカバーする音声認識技術の改善が進められています。

普及率が低い

現在、音声認識技術は進化を遂げており、多くの領域で活用の可能性が広がっています。しかし、海外に比べると日本国内における普及率は低く、ビジネスや個人の日常生活の場で十分に浸透しているとは言い難いのが現状です。

AIは活用されればされるほどインプットする情報の量が増え、精度が向上していきます。これはAI搭載型の音声認識技術についても同様ですので、今以上に普及率を高めて、より多くの情報がインプットできるようにしていく必要があります。

まとめ

音声認識は、さまざまな分野で幅広い活用が期待されている技術です。近年はAI技術の進歩によって精度が向上し、業務効率化や顧客満足度向上のためのツールとしても活用されるケースが増えてきました。

ボイスアシスタントやスマートスピーカーなど、日常生活における利便性を上げるためのツールとしても活用され、音声認識技術は私たちの暮らしに少しずつ浸透し始めていると言っても過言ではありません。

しかし、ノイズや方言、複数人での発話などが音声認識制度に影響を及ぼすという課題があり、普及率も海外諸国に比べればまだまだ低いのが現状です。今後さらに技術が進歩し、普及率も高まっていけば、音声認識技術はコミュニケーションや情報処理の手段として大きく発展していくでしょう。

AI GIJIROKU ブログ編集部です。議事録や、会議、音声を中心に生産性を向上するためのブログを執筆しています。